本文将介绍如何在基于Ubuntu的系统上安装多节点Hadoop 3.1.1集群,作者将在Ubuntu 18.04.1上安装一个包含HDFS的三节点Hadoop集群。

首先,我们需要为集群创建三个虚拟机,创建一个具有4个vCPU,4 GB内存和40 GB硬盘空间的Hadoop Master服务器;为每个节点创建两个带有4个vCPU,8 GB内存和40 GB硬盘空间的Hadoop节点。

本文的三台服务器安装了Ubuntu Server 18.04.1,安装了所有更新并重新启动,一定要确保使用静态IP地址和内部DNS解析配置每个服务器,或将每个服务器添加到/ etc / hosts文件。

准备运行Hadoop服务器

首先,我们需要安装Oracle Java 8,因为从Ubuntu 18.04.1开始,Java 8不再可用。- # add-apt-repository ppa:webupd8team/java# apt update# apt install -y oracle-java8-set-default

- # wget http://apache.claz.org/hadoop/common/hadoop-3.1.1/hadoop-3.1.1.tar.gz

- # tar -xzvf hadoop-3.1.1.tar.gz# mv hadoop-3.1.1 /usr/local/hadoop

首先,我们需要知道Java的安装位置,运行以下命令查找。- # update-alternatives --display javajava - manual mode link best version is /usr/lib/jvm/java-8-oracle/jre/bin/java link currently points to /usr/lib/jvm/java-8-oracle/jre/bin/java link java is /usr/bin/java slave java.1.gz is /usr/share/man/man1/java.1.gz/usr/lib/jvm/java-8-oracle/jre/bin/java - priority 1081 slave java.1.gz: /usr/lib/jvm/java-8-oracle/man/man1/java.1.gz

打开/etc/environment并更新PATH行以包含Hadoop二进制目录。- PATH="/usr/local/sbin:/usr/local/bin:/usr/sbin:/usr/bin:/sbin:/bin:/usr/games:/usr/local/games:/usr/local/hadoop/bin:/usr/local/hadoop/sbin"

- vim YARN_RESOURCEMANAGER_OPTS="--add-modules=ALL-SYSTEM"

接下来,我们将添加一个hadoop用户并为他们提供正确的权限。- # adduser hadoop# usermod -aG hadoop hadoop# chown hadoop:root -R /usr/local/hadoop# chmod g+rwx -R /usr/local/hadoop

- # su - hadoop# ssh-keygen -t rsa

现在以hadoop用户身份登录并将SSH密钥复制到所有Hadoop节点。 同样,只需要在Hadoop Master上完成此步骤。- # su - hadoop$ ssh-copy-id hadoop@hadoop1.admintome.lab$ ssh-copy-id hadoop@hadoop2.admintome.lab$ ssh-copy-id hadoop@hadoop3.admintome.lab

打开/usr/local/hadoop/etc/hadoop/core-site.xml文件并输入以下内容:- <configuration> <property> <name>fs.default.name</name> <value>hdfs://hadoop1.admintome.lab:9000</value> </property></configuration>

接下来,打开/usr/local/hadoop/etc/hadoop/hdfs-site.xml文件并添加以下内容:- # wget http://apache.claz.org/hadoop/common/hadoop-3.1.1/hadoop-3.1.1.tar.gz0

打开/usr/local/hadoop/etc/hadoop/workers文件并添加以下两行(每个Hadoop节点一行)- # wget http://apache.claz.org/hadoop/common/hadoop-3.1.1/hadoop-3.1.1.tar.gz1

将配置文件从Hadoop Master复制到每个Hadoop节点。- # wget http://apache.claz.org/hadoop/common/hadoop-3.1.1/hadoop-3.1.1.tar.gz2

- # wget http://apache.claz.org/hadoop/common/hadoop-3.1.1/hadoop-3.1.1.tar.gz3

- # wget http://apache.claz.org/hadoop/common/hadoop-3.1.1/hadoop-3.1.1.tar.gz4

在Hadoop Master上你应该可以看到如下结果:- # wget http://apache.claz.org/hadoop/common/hadoop-3.1.1/hadoop-3.1.1.tar.gz5

- # wget http://apache.claz.org/hadoop/common/hadoop-3.1.1/hadoop-3.1.1.tar.gz6

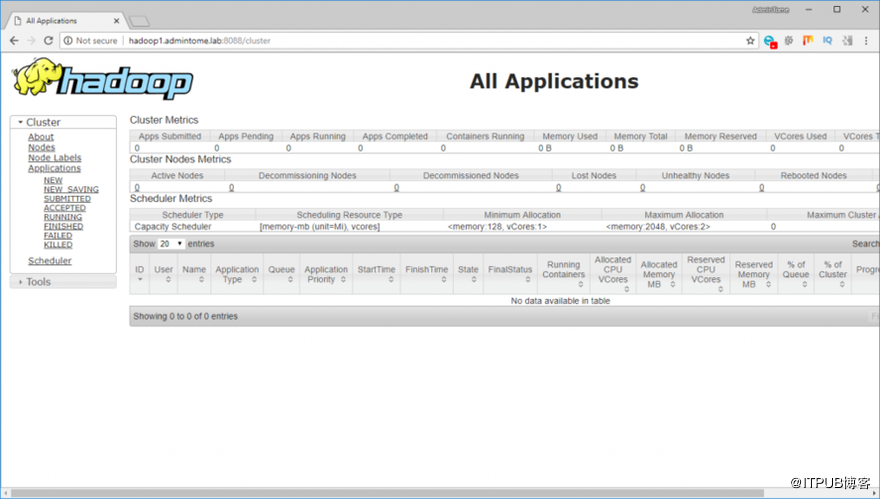

现在,我们可以通过浏览到Hadoop主服务器端口9870来访问HDFS Web UI。- # wget http://apache.claz.org/hadoop/common/hadoop-3.1.1/hadoop-3.1.1.tar.gz7

在Ubuntu 18.04.1上安装Hadoop集群

如上所示,我们的HDFS文件系统上有近60 GB的空闲空间。

开始运行Yarn

现在HDFS正在运行,我们已准备好启动Yarn调度程序。

Hadoop本身需要运行任务,因此我们需要Yarn以在Hadoop集群上合理安排任务。- # wget http://apache.claz.org/hadoop/common/hadoop-3.1.1/hadoop-3.1.1.tar.gz8

- # wget http://apache.claz.org/hadoop/common/hadoop-3.1.1/hadoop-3.1.1.tar.gz9

- # tar -xzvf hadoop-3.1.1.tar.gz# mv hadoop-3.1.1 /usr/local/hadoop0

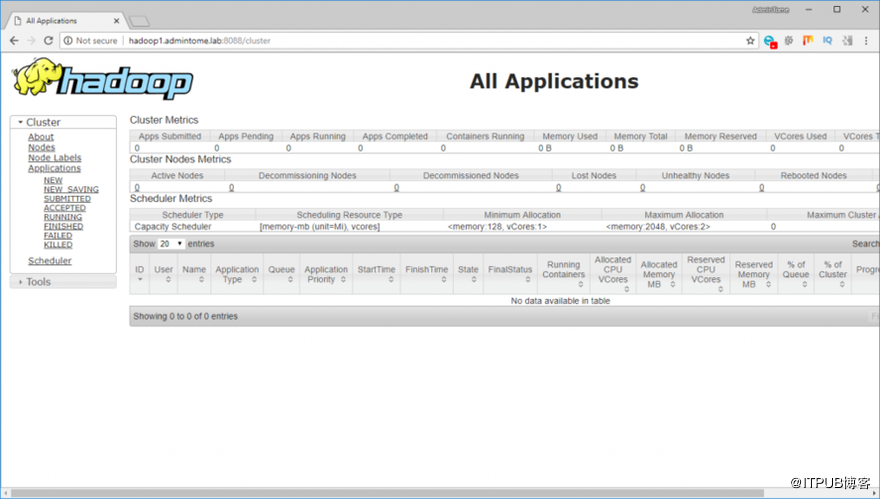

Hadoop Web UI

我们可以通过以下URL来查看Hadoop Web UI:- # tar -xzvf hadoop-3.1.1.tar.gz# mv hadoop-3.1.1 /usr/local/hadoop1

在Ubuntu 18.04.1上安装Hadoop集群

运行Hadoop任务示例

我们现在可以运行Hadoop任务示例并在集群上安排它,我们将运行的示例是使用MapReduce来计算PI。

运行以下命令来运行作业:- # tar -xzvf hadoop-3.1.1.tar.gz# mv hadoop-3.1.1 /usr/local/hadoop2

- # tar -xzvf hadoop-3.1.1.tar.gz# mv hadoop-3.1.1 /usr/local/hadoop3

|

窺視卡

窺視卡 雷達卡

雷達卡 發表於 2018-11-7 01:55:40

發表於 2018-11-7 01:55:40

提升卡

提升卡 置頂卡

置頂卡 沉默卡

沉默卡 喧囂卡

喧囂卡 變色卡

變色卡 千斤頂

千斤頂 照妖鏡

照妖鏡